via Babis Georges Petrakis

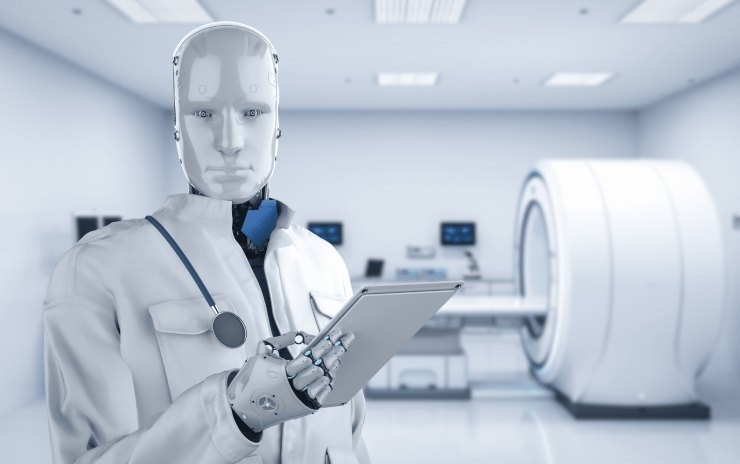

Το ολοένα δημοφιλέστερο παγκοσμίως εργαλείο δημιουργικής τεχνητής νοημοσύνης ChatGPT της αμερικανικής εταιρείας Open AI κατάφερε να πετύχει ένα ακόμη ορόσημο: να περάσει τις άκρως απαιτητικές εξετάσεις για άδεια γιατρού στις ΗΠΑ. Ένας υποψήφιος μπορεί να περάσει αυτά τα τεστ μόνο αν έχουν προηγηθεί αρκετά χρόνια ιατρικής εκπαίδευσης και εξάσκησης.

Το ChatGPT έχει καταλάβει εξαπίνης τον κόσμο και φιλοδοξεί να αποτελέσει μια πιο εξελιγμένη και δημιουργική εκδοχή της μηχανής αναζήτησης της Google (γι' αυτό άλλωστε η τελευταία "απάντησε" με το Bard).

Είναι ένα "έξυπνο" σύστημα γνωστό ως μεγάλο γλωσσικό μοντέλο (Large Language Model-LLM), σχεδιασμένο για να αξιοποιεί πληροφορίες από το διαδίκτυο και σε λίγα δευτερόλεπτα να γράφει σαν άνθρωπος διάφορα κείμενα με βάση τις ανάγκες του χρήστη, από επιστημονικά άρθρα μέχρι ποιήματα.

Οι ερευνητές της εταιρείας ιατρικής τεχνολογίας Ansible Health, οι οποίοι έκαναν τη σχετική δημοσίευση στο περιοδικό για θέματα ψηφιακής υγείας "PLoS Digital Health", δοκίμασαν κατά πόσο το ChatGPT μπορεί να απαντήσει τις περίπου 350 ερωτήσεις των τριών τεστ USMLE (United States Medical Licensing Exam). Οι εξετάσεις αυτές αξιολογούν τις ιατρικές γνώσεις σε ένα ευρύ φάσμα, από τη βιοχημεία μέχρι τη διαγνωστική ικανότητα και τη βιοηθική.

Το ChatGPT πέτυχε σκορ 52,4% έως 70%, όταν το όριο που πρέπει να περάσει ένας γιατρός, είναι περίπου το 60%. Μάλιστα στο 89% των ερωτήσεων το "έξυπνο" σύστημα παρήγαγε τουλάχιστον μία σημαντική εμπνευσμένη απάντηση, που ήταν πρωτότυπη, μη προφανής και κλινικά βάσιμη. Επίσης το ChatGPT ξεπέρασε σε επιδόσεις το PudMedGPT, ένα ανάλογο "έξυπνο" μοντέλο εκπαιδευμένο αποκλειστικά στο βιοϊατρικό πεδίο, το οποίο δεν ξεπέρασε σε βαθμολογία το 51%.

"Η επίτευξη βαθμολογίας πάνω από το όριο επιτυχίας σε αυτές τις γνωστές για τη δυσκολία τους εξειδικευμένες ιατρικές εξετάσεις, και μάλιστα χωρίς την παραμικρή ανθρώπινη βοήθεια, σηματοδοτεί ένα αξιοσημείωτο ορόσημο για την ωρίμανση της κλινικής τεχνητής νοημοσύνης", επεσήμαναν οι ερευνητές. Μάλιστα έκαναν γνωστό ότι το ίδιο το ChatGPT τους βοήθησε σημαντικά στο να γράψουν την επιστημονική δημοσίευση τους.

Όπως είπαν, "αλληλεπιδράσαμε με το ChatGPT σαν να ήταν συνάδελφος μας, ζητώντας του να συνθέσει, να απλοποιήσει και να προσφέρει επιχειρήματα στο προσχέδιο της μελέτης μας. Όλοι οι συν-συγγραφείς εκτιμήσαμε πολύ τη συμβολή του ChatGPT".

Η διεύθυνση για την επιστημονική δημοσίευση:

https://journals.plos.org/digitalhealth/article?id=10.1371/journal.pdig.0000198

Σχόλια